Kunstmatige Intelligentie (AI) heeft de afgelopen jaren ongelooflijke vooruitgang geboekt. Toch is het begrijpen van wat een AI-hallucinatie is en hoe deze te overwinnen nog steeds een voortdurend proces voor LLM-makers.

De technologie van vandaag en morgen blijft ons allemaal fascineren, vooral als het gaat om de manier waarop AI menselijke taal kan begrijpen en genereren. Er zijn enorme vooruitgang geboekt met Large Language Models (LLM’s), computerprogramma’s die zijn getraind op enorme hoeveelheden tekst. Deze LLM’s kunnen verschillende soorten creatieve tekstformaten schrijven, zoals gedichten, code, scripts, muziekstukken, e-mail, brieven, enz.

Er doet zich echter een eigenaardig probleem voor met de kracht van deze indrukwekkende modellen: ze ‘hallucineren’ soms.

Wat is een AI-hallucinatie?

Net zoals mensen dingen kunnen bedenken of bedenken die niet echt zijn, kan AI iets soortgelijks doen. AI-hallucinaties doen zich voor wanneer een LLM tekst produceert die geloofwaardig lijkt, maar feitelijk onjuist is. Deze hallucinaties kunnen variëren van kleine fouten tot volledig verzonnen verhalen en onzinnige uitspraken.

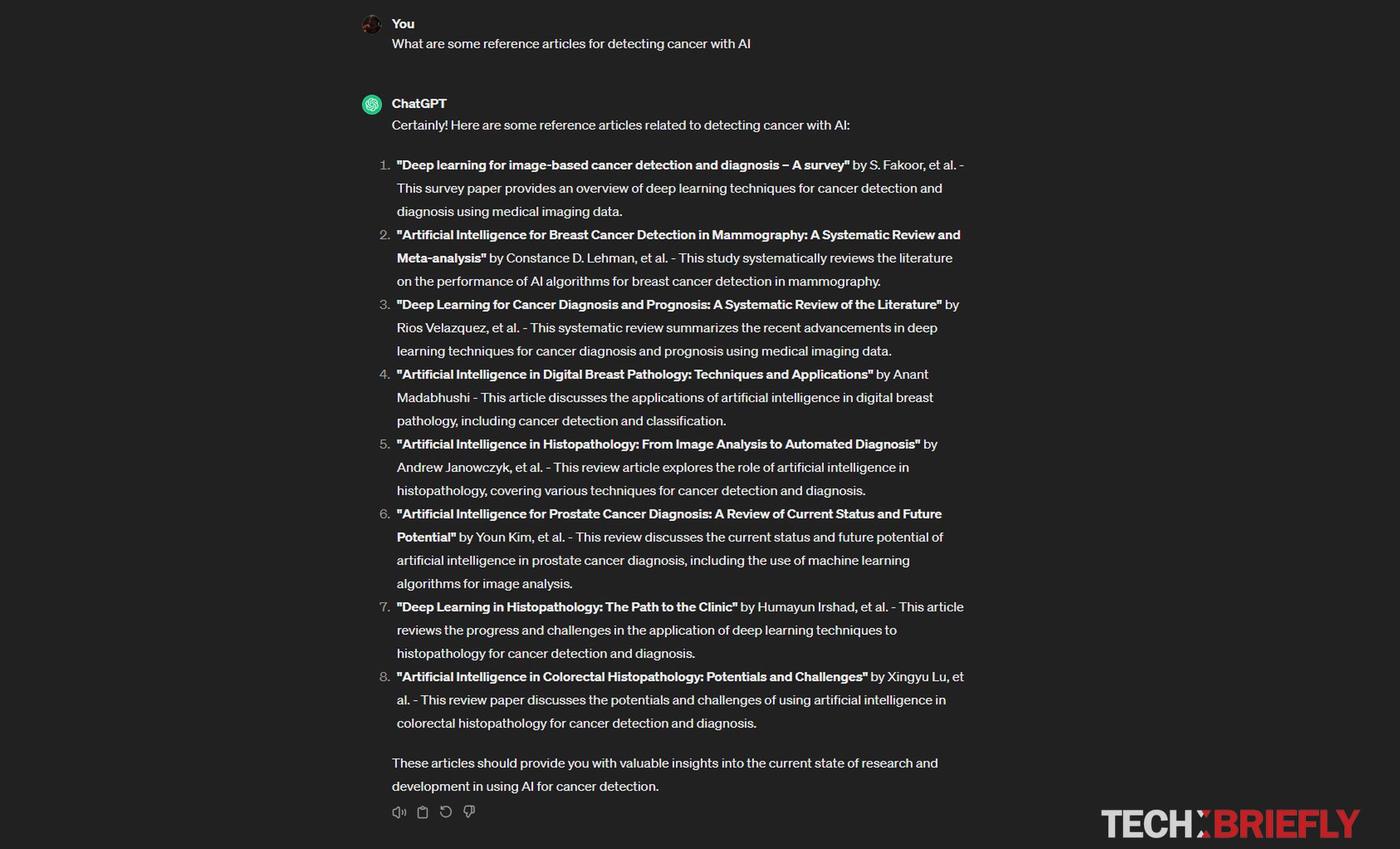

Laten we eens naar enkele voorbeelden kijken om een beter inzicht te krijgen in dit probleem:

- Feiten door elkaar halen: Een AI die wordt gevraagd een nieuwsartikel over een evenement te schrijven, kan onjuiste datums en locaties bevatten, of een verkeerde voorstelling van zaken geven aan de betrokken personen.

- Vals creëren informatie: een AI die belast is met het schrijven van een productbeschrijving kan functies verzinnen die het product eigenlijk niet heeft.

- Zeker onjuist: Het erg lastige van AI-hallucinaties is dat ze vaak op een zeer overtuigende manier worden gepresenteerd, waardoor het moeilijk is om ze te onderscheiden van echte informatie.

Waarom zijn hallucinaties een probleem voor LLM’s?

Zoals je kunt zien in onze uitleg over wat een AI-hallucinatie is, vormen ze om verschillende redenen een groot probleem voor LLM’s. Ten eerste: als mensen de tekst die een LLM genereert niet kunnen vertrouwen, verliezen gebruikers het vertrouwen in het algemene nut en de betrouwbaarheid van de technologie. Stel je voor dat je een online samenvatting leest van een nieuwsverhaal geschreven door een LLM. Als de samenvatting feitelijke fouten bevat, kunt u mogelijk helemaal stoppen met het gebruik van die bron. Dit kan een groot probleem zijn voor elke applicatie die afhankelijk is van LLM’s om tekst te genereren, zoals chatbots, virtuele assistenten of geautomatiseerde tools voor het maken van inhoud.

Ten tweede kunnen AI-hallucinaties bijdragen aan de verspreiding van desinformatie. In een tijd waarin nepnieuws al een groot probleem is, kan door AI gegenereerde tekst die geloofwaardig lijkt, gemakkelijk worden aangezien voor echte informatie. Dit kan een negatieve invloed hebben op alles, van het publieke debat tot belangrijke besluitvormingsprocessen. Stel je bijvoorbeeld voor dat een LLM berichten op sociale media maakt over een politieke kandidaat die valse informatie bevat.

Deze berichten kunnen kiezers misleiden en de uitslag van verkiezingen beïnvloeden. Dat is precies de reden waarom Google de mogelijkheid van Gemini om te reageren op verkiezingsgerelateerde vragen heeft uitgeschakeld.

Ten derde kunnen bedrijven of organisaties die LLM’s gebruiken, te maken krijgen met reputatieschade als hun AI-systemen onnauwkeurige of schadelijke inhoud produceren. Stel dat een bedrijf een LLM gebruikt om productbeschrijvingen voor zijn online winkel te schrijven. Als de LLM functies uitvindt die de producten eigenlijk niet hebben, kan dit leiden tot ontevredenheid bij de klant en de reputatie van het bedrijf schaden.

Waarom gebeuren AI-hallucinaties?

Je hebt nu enkele ideeën over wat een AI-hallucinatie is, maar waarom gebeuren ze? Verschillende factoren dragen bij aan dit probleem:

- Hoe ze zijn opgeleid: LLM’s krijgen enorme hoeveelheden tekstgegevens te verwerken. Deze gegevens bevatten vaak fouten, vooroordelen en verouderde informatie. De AI leert van deze data, net zoals zij dat doet van correcte informatie.

- Begrijpen versus creëren: LLM’s zijn goed in het begrijpen van patronen in taal, maar ze hebben niet altijd een goed begrip van concepten of logica uit de echte wereld. Ze kunnen iets genereren dat plausibel klinkt, zonder dat het daadwerkelijk waar is.

- De zoektocht naar vloeiendheid: LLM’s zijn ontworpen om tekst te produceren die natuurlijk en menselijk klinkt. Soms betekent dit het “opvullen van de lege plekken” waar er gaten kunnen zitten in de kennis van de AI. Deze ingevulde lege plekken kunnen ertoe leiden dat de AI inhoud verzint.

Wat wordt er gedaan om dit op te lossen?

Onderzoekers en ontwikkelaars in de AI-gemeenschap werken actief aan manieren om AI-hallucinaties te verminderen.

Enkele van de benaderingen zijn onder meer:

- Betere trainingsgegevens: Het creëren van zorgvuldig samengestelde datasets die minder snel fouten en vooroordelen bevatten, wat leidt tot verbeterd AI-gedrag.

- Feiten controleren: Het ontwikkelen van technieken om door AI gegenereerde tekst te vergelijken met betrouwbare bronnen, waardoor de nauwkeurigheid ervan wordt gewaarborgd.

- Uitlegbaarheid: LLM’s ontwerpen die hun redeneringsproces kunnen verklaren, waardoor het gemakkelijker wordt om potentiële fouten op te sporen

- Samenwerking tussen mens en AI: Systemen bouwen waarin mens en AI samenwerken, waardoor het gemakkelijker wordt om hallucinaties te identificeren en te corrigeren.

Daarnaast stelt Jensen Huang van Nvidia dat AI-hallucinaties binnen de komende vijf jaar kunnen worden genezen.

AI-hallucinaties zijn dus een complexe uitdaging, maar het is een cruciale uitdaging die moet worden overwonnen als LLM’s hun volledige potentieel willen bereiken. Naarmate technologieën om hallucinaties te verminderen steeds geavanceerder worden, beloven ze dat LLM’s een veel betrouwbaarder en waardevoller instrument zullen worden voor communicatie, creativiteit en kennistaken.

Uitgelicht beeldtegoed: vackground.com/Ontsplashen

Source: Wat is een AI-hallucinatie en waarom is het een groot probleem voor de toekomst van LLM’s?