Kent u de geschiedenis van AI-technologieën waarover voortdurend wordt gesproken? Vandaag duiken we in het onderwerp: ”Hoe lang bestaat AI al?” samen met jou.

Kunstmatige intelligentie (AI), een relatief nieuw vakgebied met ongeveer 60 jaar geschiedenis, is een verzameling wetenschappen, theorieën en methoden die menselijke cognitieve vermogens proberen na te bootsen. Waaronder:

- Wiskundige logica

- Statistieken, waarschijnlijkheid

- Computationele neurowetenschappen

- Computertechnologie

Beginnend tijdens de Tweede Wereldoorlog, zijn de vorderingen nauw verbonden met die van computers en hebben computers in staat gesteld om steeds gecompliceerdere taken op zich te nemen die voorheen uitsluitend geschikt waren voor mensen.

Hoe lang bestaat AI?

Sinds 1940 is de uitdrukking kunstmatige intelligentie (AI) in ons leven. Sommige experts vinden de term misleidend omdat deze technologie nog ver verwijderd is van echte menselijke intelligentie. Hun studie is nog niet zover gevorderd dat ze kan worden vergeleken met de huidige prestaties van de mensheid. Vooruitgang in de fundamentele wetenschap zou nodig zijn om de “sterke” AI, die nog maar pas in sciencefiction is verschenen, in staat te stellen de hele wereld te modelleren.

Sinds 2010 is het veld echter opnieuw populair geworden, vooral als gevolg van aanzienlijke vooruitgang in computerverwerkingskracht en gemakkelijke toegang tot grote hoeveelheden gegevens. Een objectief begrip van de problematiek wordt belemmerd door herhaalde beloften en zorgen waar af en toe over gefantaseerd wordt.

Een korte terugblik op de geschiedenis van het vakgebied kan naar onze mening dienen om huidige discussies te kaderen.

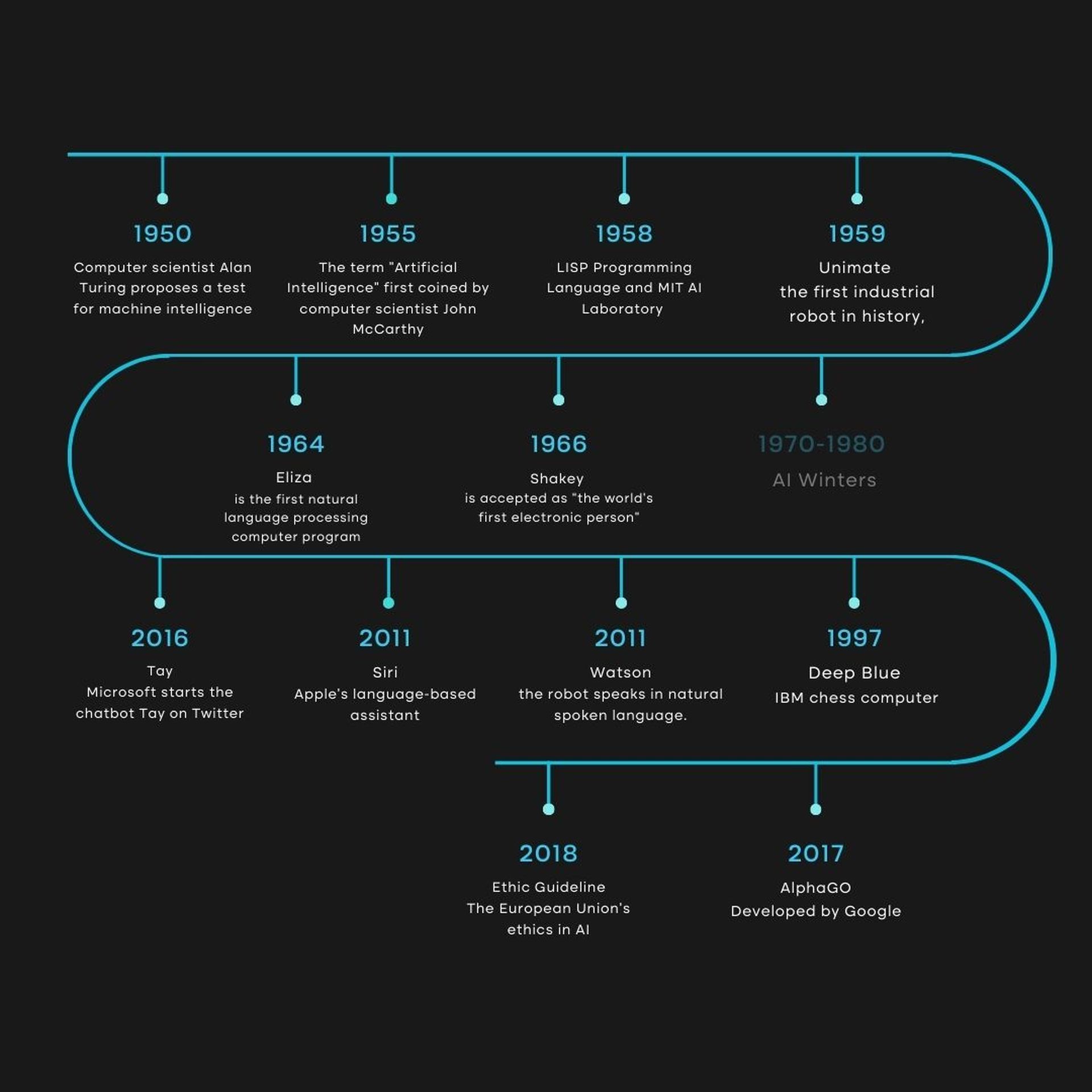

1940–1960: de geboorte van AI

De samenvloeiing van technologische vooruitgang en de zoektocht om te begrijpen hoe het functioneren van machines en organische wezens tussen 1940 en 1960 te combineren, heeft een blijvende indruk achtergelaten.

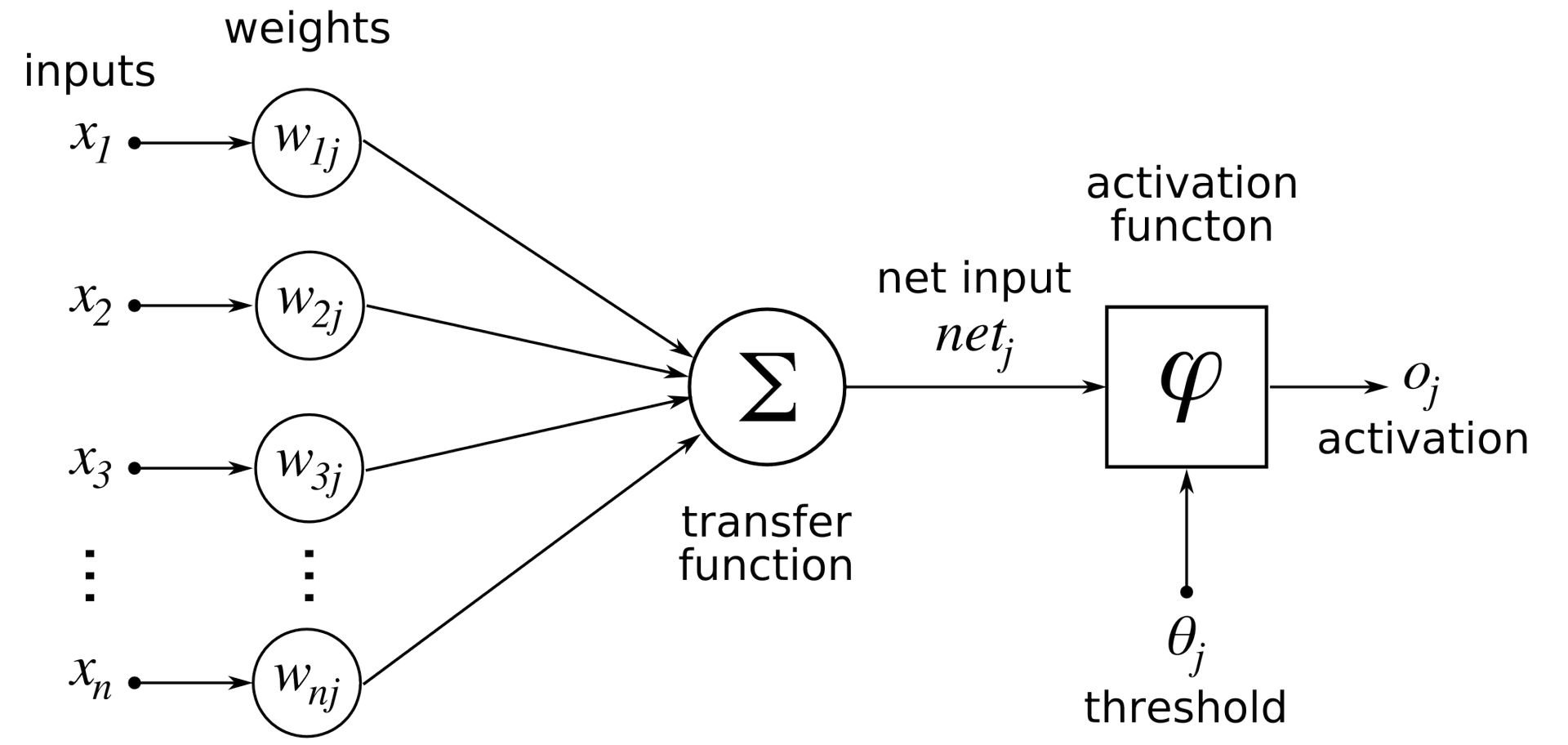

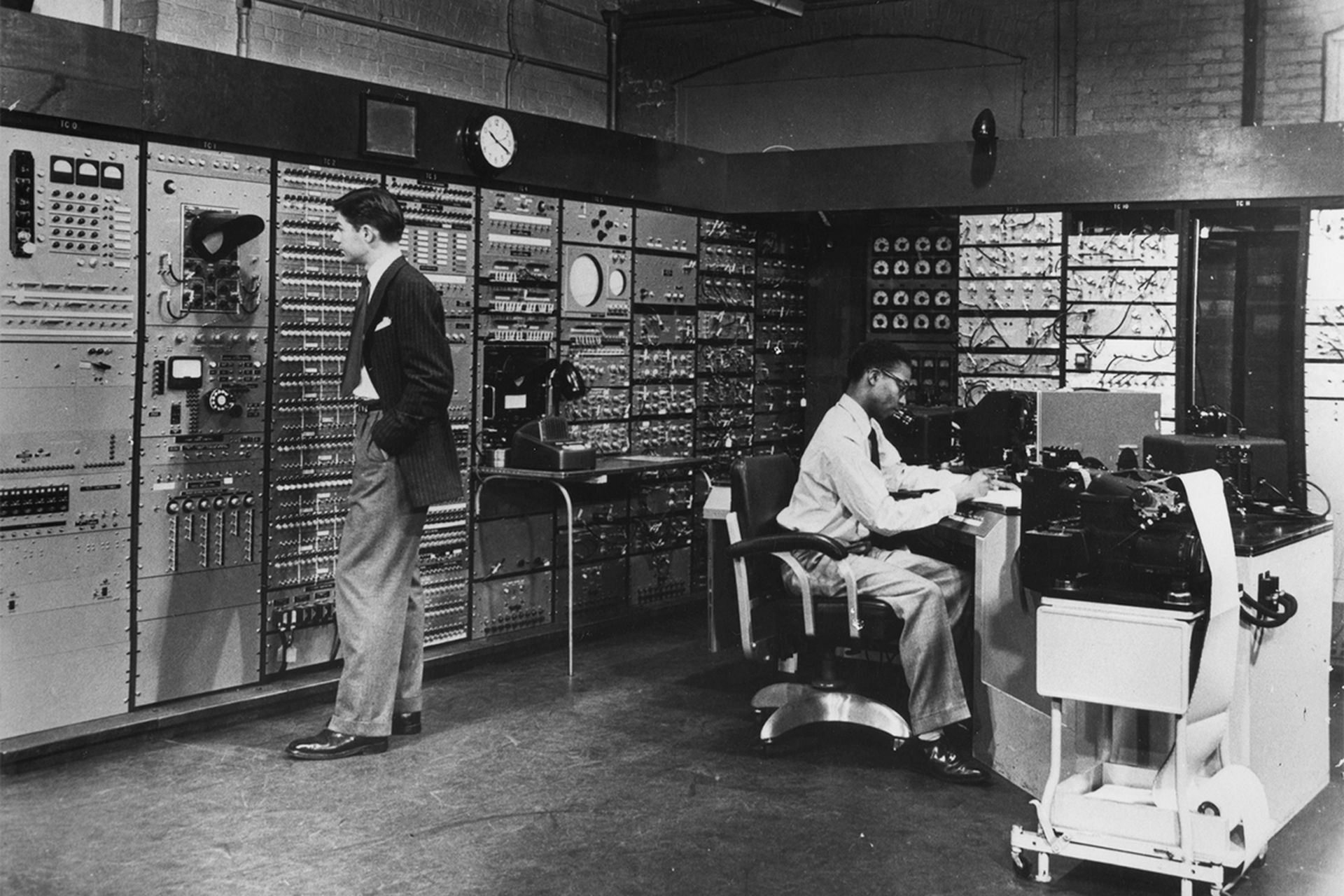

Om “een hele theorie van controle en communicatie te creëren, zowel bij dieren als bij machines”, zag Norbert Wiener, een pionier op het gebied van cybernetica, de noodzaak in om wiskundige theorie, elektronica en automatisering te integreren. Daarvoor creëerden Warren McCulloch en Walter Pitts in 1943 het eerste wiskundige en computermodel van het biologische neuron.

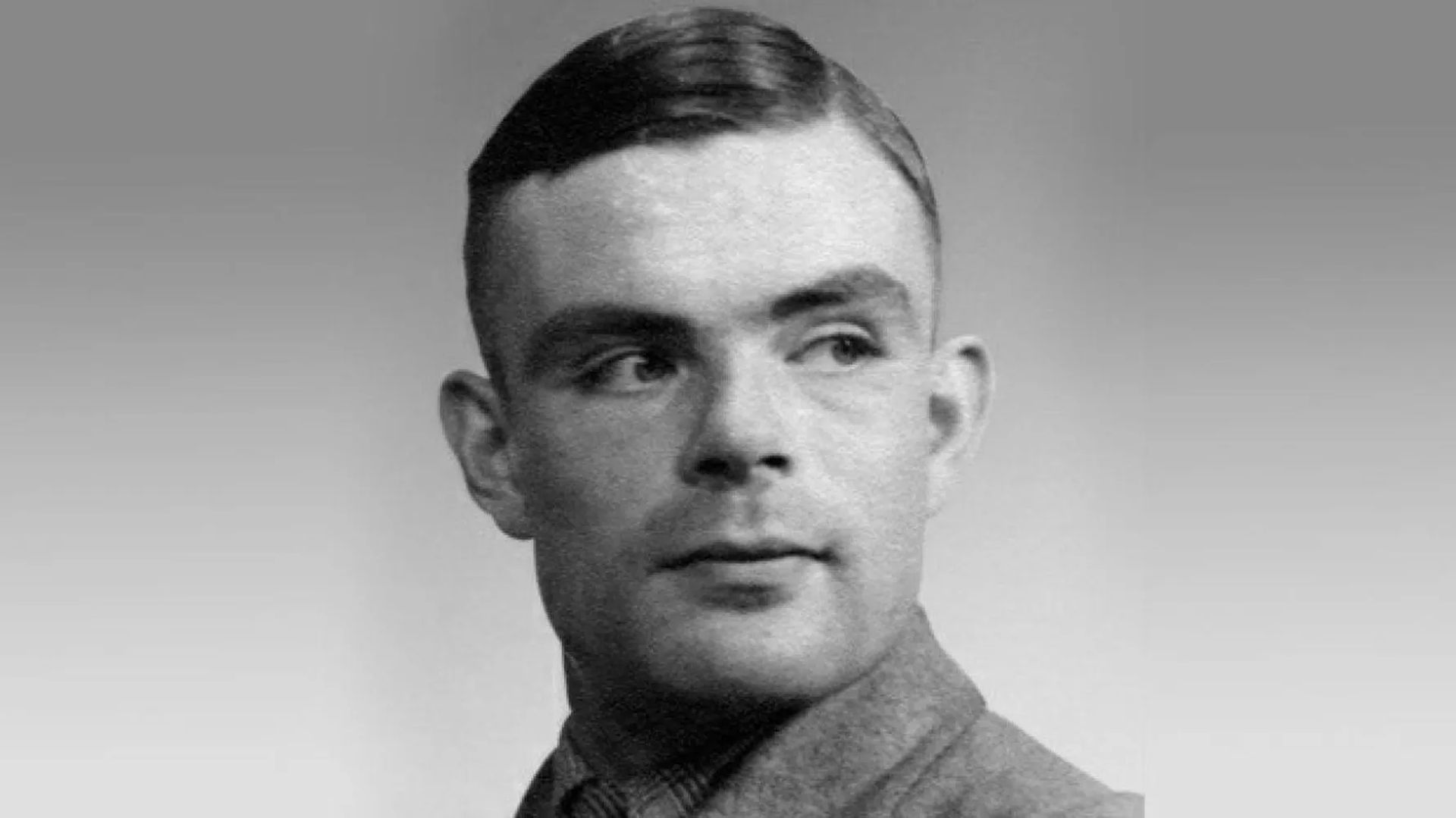

Hoewel ze begin 1950 de term kunstmatige intelligentie (AI) niet hebben uitgevonden, waren John Von Neumann en Alan Turing de pioniers van de technologie die eraan ten grondslag ligt. Ze hielpen computers om te schakelen naar 19e-eeuwse decimale logica en machines naar binaire logica. Zo codificeerden de twee onderzoekers de architectuur van de hedendaagse computers en toonden ze aan dat ze een universeel apparaat waren dat kon uitvoeren wat was geprogrammeerd. Turing, aan de andere kant, definieerde een “spel van imitatie” waarin een persoon in een teletype-gesprek zou moeten kunnen zien of hij voor het eerst tegen een mens of een machine spreekt in zijn beroemde artikel uit 1950 “Computing Machinery and Intelligentie.”

Hoe controversieel het ook mag zijn, dit stuk wordt vaak beschouwd als het startpunt voor discussies over waar de grens tussen mens en machine moet worden getrokken.

John McCarthy van MIT wordt gecrediteerd voor het uitvinden van “AI”, wat Marvin Minsky definieert als:

“De ontwikkeling van computerprogramma’s die taken uitvoeren die momenteel beter door mensen kunnen worden gedaan, omdat ze mentale processen op hoog niveau vereisen, zoals perceptueel leren, geheugenorganisatie en kritisch redeneren.”

De discipline zou zijn begonnen op een symposium dat in de zomer van 1956 op Dartmouth College werd gehouden. Anekdotisch is het belangrijk om de workshop te vermelden die diende als het belangrijkste evenement van de conferentie. McCarthy en Minsky waren twee van de zes personen die continu aan deze inspanning hebben deelgenomen.

In het begin van de jaren zestig nam de aantrekkingskracht van technologie af, hoewel het opwindend en veelbelovend bleef. Vanwege het kleine geheugen van de computers was het gebruik van een computertaal een uitdaging.

De IPL, of informatieverwerkingstaal, had het dus mogelijk gemaakt om al in 1956 het LTM-programma te ontwikkelen, dat probeerde wiskundige stellingen te tonen. Er waren echter ook enkele fundamenten die nog steeds aanwezig zijn, zoals de oplossingsbomen om wiskundige stellingen oplossen.

1980-1990: Expertsystemen

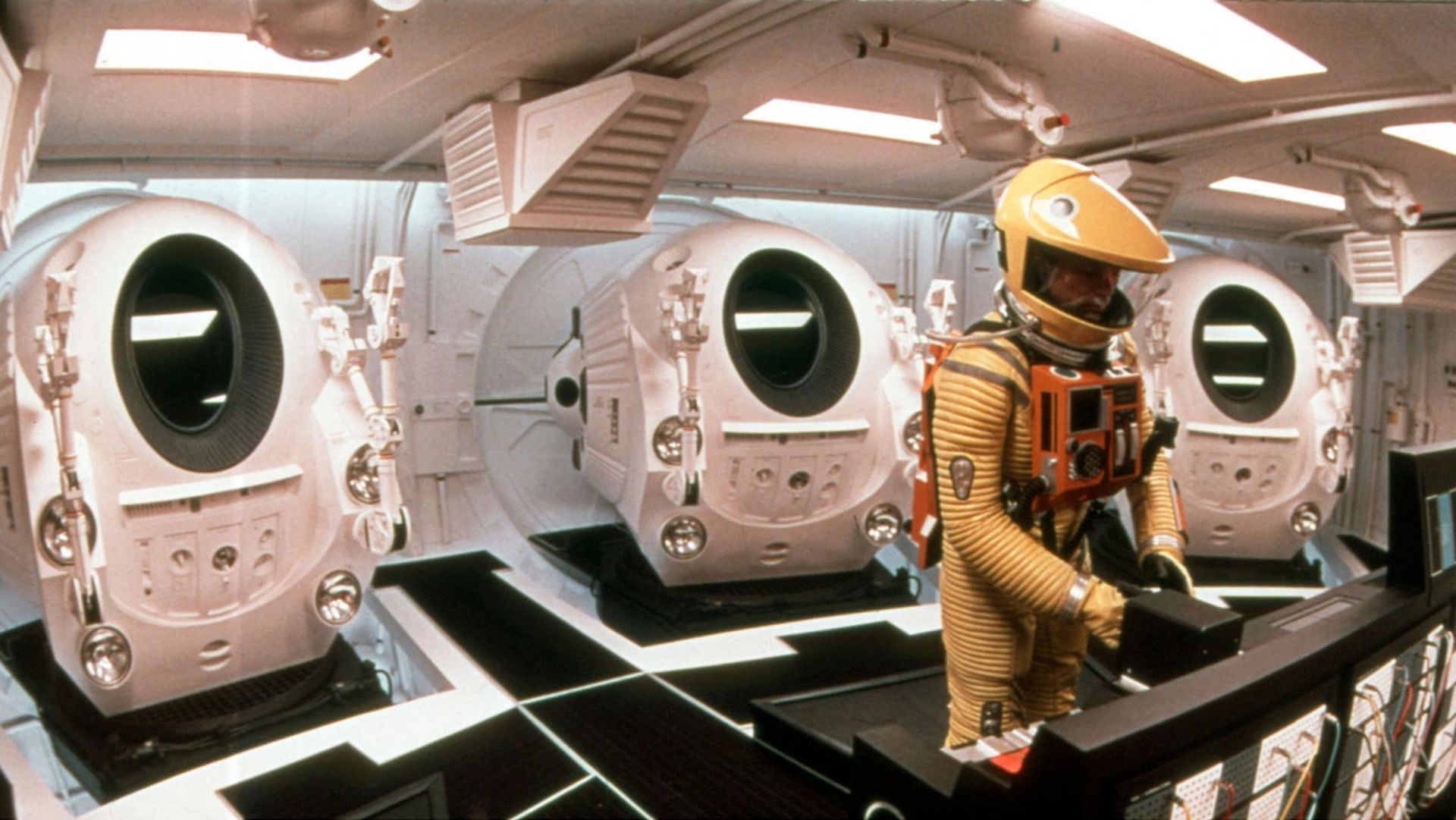

De film ‘2001 Space Odyssey’ uit 1968, geregisseerd door Stanley Kubrick, bevat een computer met de naam HAL 9000 die alle ethische bezwaren van kunstmatige intelligentie samenvat:

“Zal het zeer geavanceerd zijn, heilzaam voor de mensheid of een gevaar?”

De invloed van de film zal uiteraard niet wetenschappelijk zijn, maar het zal helpen om het thema bekender te maken, net zoals sciencefictionschrijver Philip K. Dick, die zich altijd zal blijven afvragen of machines ooit emoties kunnen voelen.

De eerste microprocessors werden eind 1970 geïntroduceerd en expertsystemen bereikten hun hoogtijdagen toen AI opnieuw een vlucht nam. De aanpak werd in 1972 openbaar gemaakt aan de Stanford University met MYCIN en aan het MIT in 1965 met DENDRAL. Deze systemen vertrouwden op een ‘inferentie-engine’, die was gebouwd als een logische replica van menselijk redeneren. Door het informatie te geven, produceerde de engine zeer deskundige antwoorden.

De beloften voorspelden een aanzienlijke vooruitgang, maar eind 1980 of begin 1990 zou het enthousiasme een hoogtepunt hebben bereikt. Het kostte veel werk om dergelijke informatie te implementeren, en tussen de 200 en 300 regels was er een “black box”-effect dat de logica van de machine verdoezelde. Zo werden creatie en onderhoud ongelooflijk moeilijk, en het belangrijkste was dat er tal van andere, snellere, minder moeilijke en meer betaalbare opties beschikbaar waren. Er moet aan worden herinnerd dat in de jaren negentig de uitdrukking “kunstmatige intelligentie” zo goed als verdwenen was uit de academische woordenschat en dat er zelfs meer ingetogen vormen, zoals “geavanceerde computers”, waren binnengekomen.

In mei 1997 behaalde IBM’s supercomputer Deep Blue’s een overwinning tegen Garry Kasparov in een schaakwedstrijd, maar het moedigde de financiering en vooruitgang van dit type AI niet aan.

Deep Blue opereerde via een methodische brute force-benadering waarbij alle mogelijke bewegingen werden gewogen en geëvalueerd. Hoewel Deep Blue slechts in staat was geweest om een relatief klein gebied aan te vallen en verre van de complexiteit van de wereld kon simuleren, bleef de nederlaag van de mens een enorm symbolische gebeurtenis in de geschiedenis.

2010-heden: het moderne tijdperk van AI

AI-technologieën, die in de schijnwerpers kwamen na de nederlaag van Kasparov tegen de supercomputer Deep Blue, bereikten medio 2010 een hoogtepunt. Twee factoren kunnen de nieuwe hausse in de discipline rond 2010 verklaren:

- Toegang tot enorme hoeveelheden data

- Ontdekking van processors voor grafische kaarten van computers die extreem efficiënt werken

De openbare prestaties die door deze nieuwe technologie mogelijk zijn gemaakt, hebben geleid tot meer investeringen, en Watson, IBM’s AI, zal in 2011 twee Jeopardy-kampioenen verslaan.

Een AI zal in 2012 katten in video’s kunnen identificeren dankzij Google X. Voor deze laatste uitdaging waren meer dan 16.000 processors nodig, maar het potentieel van een machine om onderscheid te leren maken tussen verschillende dingen was verbluffend.

In 2016 zouden Lee Sedol en Fan Hui, de Europese en wereldkampioenen in Go Games, verliezen van Google’s AI AlphaGO.

Waar komt dit wonder vandaan? Een radicale afwijking van expertsystemen. De methodologie is veranderd in inductief; in plaats van codeerregels zoals in het geval van expertsystemen, is het nu noodzakelijk om computers onafhankelijk van elkaar deze te laten ontdekken door middel van correlatie en categorisatie op basis van enorme hoeveelheden gegevens.

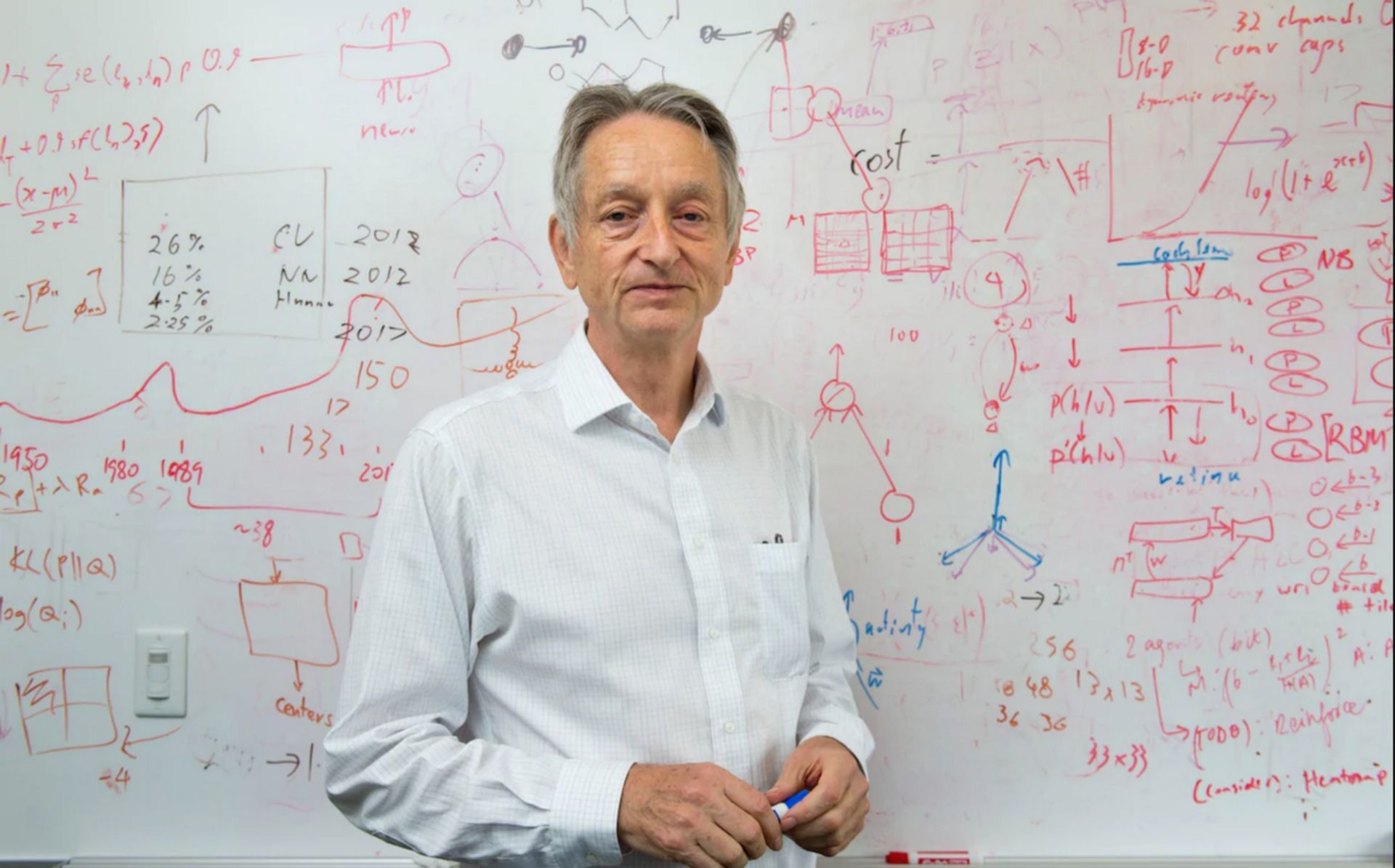

Diep leren lijkt de meest veelbelovende machine learning-technologie voor een verscheidenheid aan toepassingen. Geoffrey Hinton, Yoshua Bengio en Yann LeCun besloten in 2003 een onderzoeksprogramma te starten om neurale netwerken te moderniseren. Met de hulp van het Toronto-laboratorium werden tegelijkertijd experimenten uitgevoerd op Microsoft, Googleen IBM onthulde dat dit soort leren succesvol was in het halveren van de foutpercentages voor spraakherkenning. Het beeldherkenningsteam van Hinton had vergelijkbaar succes.

Bijna van de ene op de andere dag adopteerde de overgrote meerderheid van de onderzoeksteams deze technologie, die onmiskenbare voordelen had. Hoewel de tekstherkenning dankzij deze vorm van leren aanzienlijk is verbeterd, is er volgens specialisten als Yann LeCun nog een lange weg te gaan voordat er systemen voor tekstbegrip kunnen worden gecreëerd.

Gespreksagenten zijn een goede illustratie van deze moeilijkheid: terwijl onze smartphones momenteel in staat zijn om instructies te transcriberen, zijn ze niet in staat om ze goed in hun context te plaatsen of onze intenties te onderscheiden.

Zo hebben we de ontwikkeling van AI-technologieën tot nu toe voor u samengevat. Blijf ons lezen zodat u niet onwetend blijft over het laatste nieuws over AI-technologieën zoals Notion AI en Meta Galactica AI

Source: Hoe lang bestaat AI: geschiedenis van kunstmatige intelligentie uitgelegd