Meta’s Segment Anything Model (SAM) AI is een baanbrekende innovatie op het gebied van beeld- en videobewerking.

Meta, het moederbedrijf van Facebook en Instagram, heeft onlangs een baanbrekend nieuw model voor kunstmatige intelligentie (AI) onthuld dat het potentieel heeft om een revolutie teweeg te brengen in beeld- en videobewerking. Het model, bekend als het Segment Anything Model (SAM), kan elk object in foto’s en video’s “uitknippen” met slechts één klik.

Deze opmerkelijke technologie is in staat om objecten in realtime met opmerkelijke nauwkeurigheid te segmenteren, en Meta heeft het open source gemaakt, waardoor andere ontwikkelaars het kunnen gebruiken en verbeteren.

Naarmate we in ons dagelijks leven steeds meer vertrouwen op visuele inhoud, zullen innovaties zoals het SAM AI-model steeds belangrijker worden. Of het nu gaat om het verbeteren van fotobewerkingssoftware of het helpen bij het herkennen van objecten en het volgen van video-inhoud, het Segment Anything Model heeft het potentieel om de manier waarop we visuele media creëren en ermee omgaan te transformeren.

Wat is het Segment Anything-model?

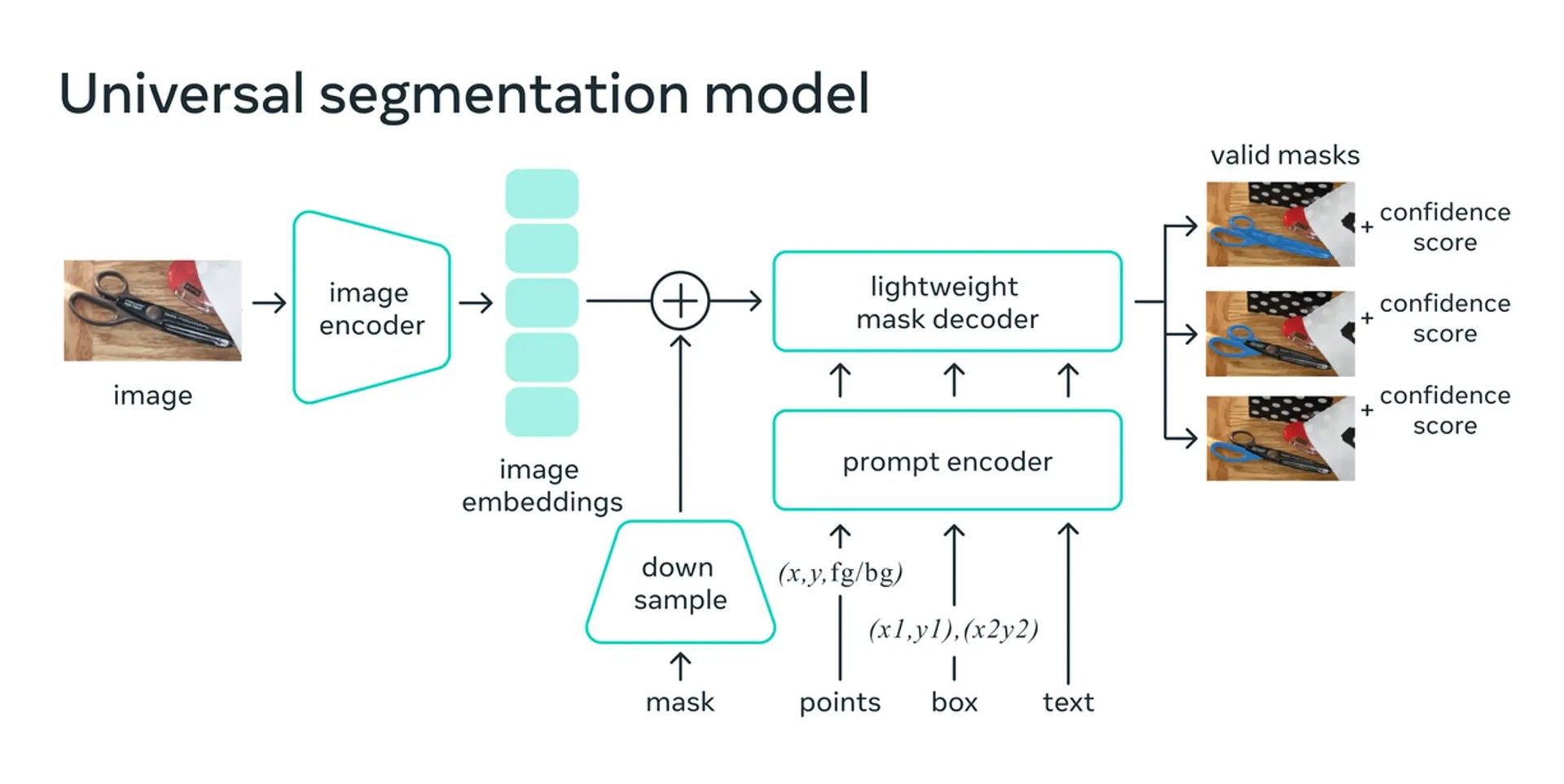

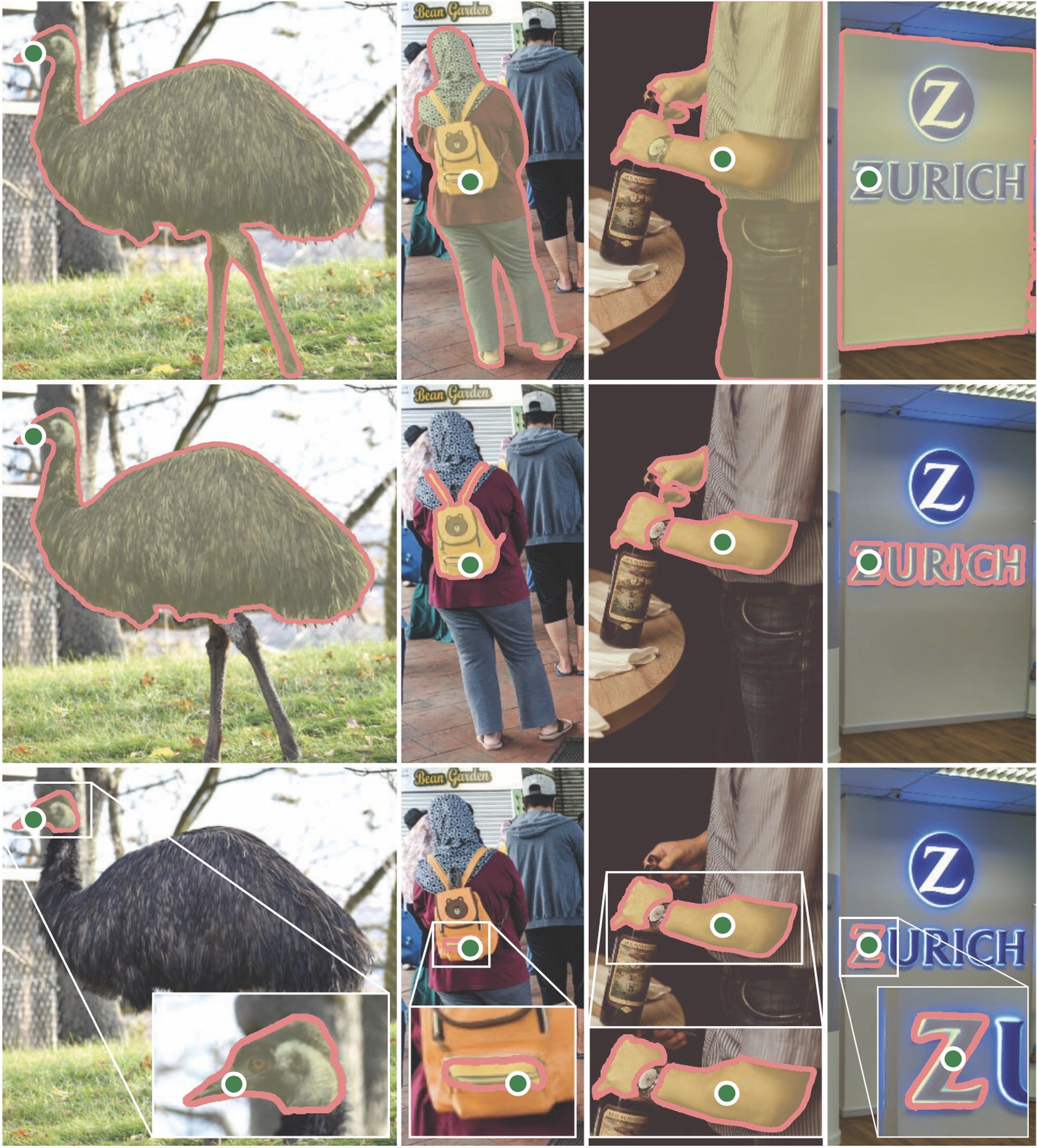

Het Segment Anything Model (SAM) is een geavanceerd AI-model dat verschillende invoerprompts gebruikt om te specificeren wat er in realtime moet worden gesegmenteerd. Hoewel er al verschillende door AI aangedreven clipping- of vervangingssystemen op de markt zijn, is de SAM dat wel uniek in zijn vermogen om grote objecten te isoleren in een afbeelding zonder in te hoeven zoomen voor fijne details.

Zodra een afbeelding is berekend, doet de AI uitstekend werk door de belangrijkste objecten in de afbeelding te isoleren. De SAM kan individuele objecten in een afbeelding herkennen en isoleren, en gebruikers kunnen tijdens de live demo zien hoe de technologie werkt.

Hoewel het Segment Anything Model mogelijk geen extreem fijne details oppikt in grotere afbeeldingen, kan het toch de meeste objecten gemakkelijk identificeren en isoleren. Bovendien is het Segment Anything-model slim genoeg om delen van objecten te herkennen, zelfs als ze niet volledig scherp zijn.

De indrukwekkende mogelijkheden van de SAM zijn te danken aan de training op miljoenen afbeeldingen en maskers via een model-in-the-loop “data-engine”. De AI is in staat tot volledig automatische annotatie, dankzij het geavanceerde dubbelzinnigheidbewuste ontwerp. Met meer dan 1,1 miljard segmentatiemaskers verzameld op ongeveer 11 miljoen gelicentieerde en privacybeschermende afbeeldingen, kan het Segment Anything Model uitvoer meerdere maskers, zelfs voor dubbelzinnige onderwerpen.

Voordelen van het Segment Anything-model

Het Segment Anything Model (SAM) heeft verschillende voordelen ten opzichte van bestaande door AI aangedreven clipping- of vervangingssystemen. Hoewel Adobe Photoshop’s content-aware fill en Apple’s “lift and drop”-functie opmerkelijke voorbeelden zijn van dergelijke systemen, SAM is uniek in zijn vermogen om met gemak grote objecten in een afbeelding te segmenteren. Deze technologie kan veel potentiële toepassingen hebben, van het verbeteren van fotobewerkingssoftware tot het helpen bij objectherkenning en het volgen van video-inhoud.

De SAM is open sourceen Meta heeft de volledige dataset die de AI aandrijft, beschikbaar gemaakt om te downloaden van zijn website en Github die u kunt openen via de link hier. Dit maakt het voor andere ontwikkelaars mogelijk om de technologie te gebruiken en te verbeteren, wat zou kunnen leiden tot verdere innovaties in beeld- en videobewerking.

Beperkingen van het Segment Anything-model

Hoewel de SAM een indrukwekkend AI-model is met veel potentiële toepassingen, heeft het enkele beperkingen. Het bijvoorbeeld extreem fijne details in grotere afbeeldingen mogelijk niet oppikken, zoals individuele mensen in een groot stadsbeeld. Dit is echter een kleine beperking gezien het vermogen van de SAM om de meeste objecten gemakkelijk te isoleren.

Een andere beperking is dat de SAM moeite kan hebben complexere afbeeldingen met veel onopvallende lichtvlekken, zoals een foto van de Tarantulanevel gemaakt door de James Webb Space Telescope. Dit is echter niet verwonderlijk gezien de complexiteit van dergelijke afbeeldingen, en het is nog steeds een indrukwekkende prestatie dat de SAM met gemak objecten in de meeste afbeeldingen kan segmenteren.

De onthulling van Meta’s Segment Anything Model (SAM) AI is een belangrijke mijlpaal in de wereld van beeld- en videobewerking. Deze technologie heeft het potentieel om de manier waarop we visuele inhoud bewerken en manipuleren te veranderen, en de indrukwekkende mogelijkheden ervan zijn een bewijs van de kracht van AI. Het vermogen van de SAM om met gemak grote objecten in een afbeelding te isoleren, is bijzonder indrukwekkend, en het open source-karakter betekent dat ontwikkelaars de technologie nog verder kunnen voortbouwen en verbeteren.

Het is een opwindende tijd voor de wereld van AI, en het Segment Anything Model is een uitstekend voorbeeld van hoe technologie zich in een ongelooflijk tempo ontwikkelt. Hoewel AI-technologieën al heel lang niet meer in ons leven zijn, bevat vanaf 2023 bijna elk elektronisch apparaat dat we om ons heen zien NLP of vergelijkbare technologieën. Laten we eens kijken hoe dicht we in 2024 zullen komen bij de toekomst waarvan we dromen in sciencefictionfilms. we geloofden dat zelfs de automatische deuren die we in Star Trek zagen in werkelijkheid niet konden bestaan.

Source: Segment Anything Model: wat kan Meta’s nieuwe SAM doen?