Apple heeft besloten verder te gaan in de strijd tegen kinderpornografie. Het bedrijf heeft een nieuw scan- en coderingssysteem gemaakt waarmee het de foto’s van zijn gebruikers zal volgen op zoek naar verdachte inhoud. De nieuwe functie op basis van machine learning zal voorlopig niet naar sommige landen komen, deze zal eerst worden getest in de Verenigde Staten, maar heeft al argwaan gewekt bij cybersecurity-experts.

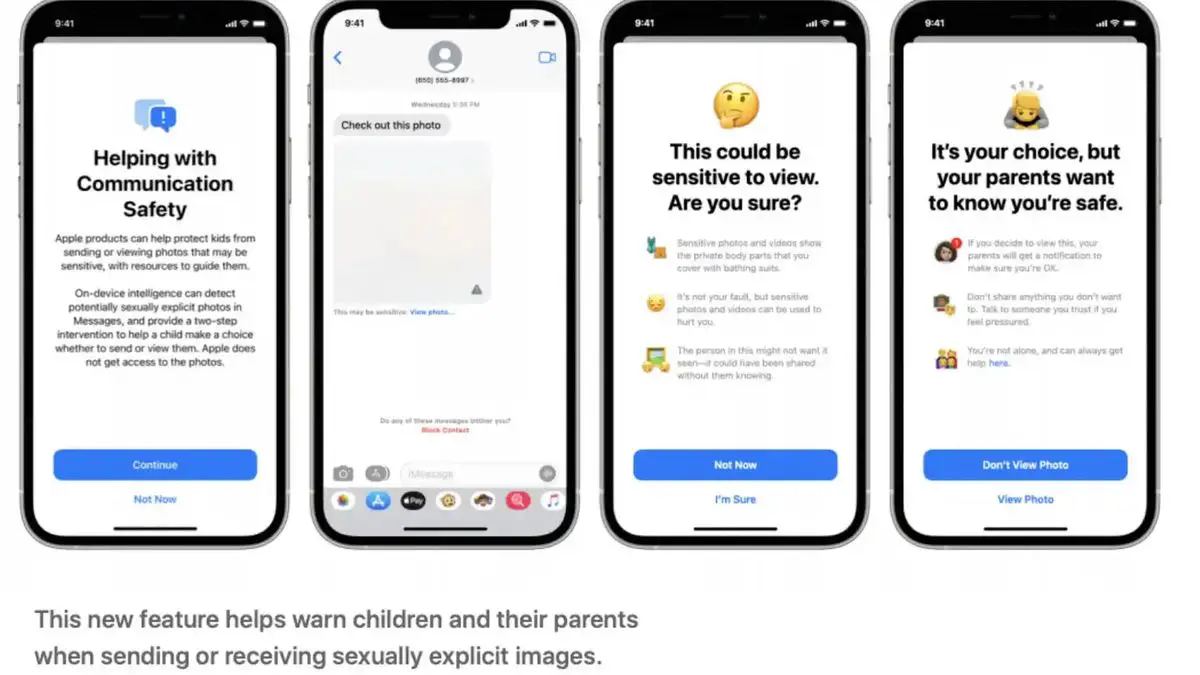

Het bedrijf bevestigde daarmee de informatie die Matthew Green, hoogleraar cryptografie aan de Johns Hopkins University, donderdag op Twitter had verspreid. Vanaf nu ontvangen iPhone-gebruikers een waarschuwing als een van de afbeeldingen die ze via iMessage proberen te verzenden, wordt verdacht van seksueel misbruik van minderjarigen.

“Berichten maakt gebruik van machine learning op het apparaat om afbeeldingsbijlagen te analyseren en te bepalen of een foto seksueel expliciet is. De functie is zo ontworpen dat Apple geen toegang heeft tot Berichten’-details van Apple in een rapport waarin wordt uiteengezet hoe dit systeem werkt, wat niet zo nieuw is als het klinkt.

Hoe werkt het?

De technologie zal worden gebruikt in iOS, macOS, WatchOS en iMessages van waaruit alle afbeeldingen die gebruikers willen delen, worden geanalyseerd. Om dit te doen, hebben ze hun toevlucht genomen tot machine learning-algoritmen die bekend staan als NeuralHash.

De hash-technologie analyseert de afbeelding zonder dat u deze hoeft te bekijken of het bestand hoeft te openen. Het zet elke foto om in een uniek nummer dat de inhoud beschrijft, zoals een digitale vingerafdruk, maar dat voor geen enkele gebruiker te begrijpen is.

Nadat die code is vergeleken met de code die door het bedrijf als verdachte inhoud is vastgesteld, wordt er een waarschuwing gemaakt die de afbeelding vervaagt en blokkeert om te worden gedeeld als er voldoende overeenkomsten worden gedetecteerd tussen de ene code en de andere.

Apple zorgt ervoor dat ouders waarschuwingen kunnen ontvangen als hun kinderen inhoud willen verzenden die als verdacht is geclassificeerd. De autoriteiten kunnen ook op deze wedstrijden worden gewaarschuwd, zodat een menselijk team de beelden kan bekijken.

Matthew Groen legt op zijn Twitter-account uit dat deze technologie valse positieven kan geven omdat ze niet erg nauwkeurig zijn: “Dit is expres. Ze zijn ontworpen om afbeeldingen te vinden die op slechte afbeeldingen lijken, zelfs als ze zijn verkleind, gecomprimeerd, enz.” Het bedrijf ontkent deze bewering: “Het risico dat het systeem een account ten onrechte markeert, is extreem laag. Bovendien beoordeelt Apple handmatig alle rapporten die aan NCMEC zijn gemaakt om de nauwkeurigheid van de rapporten te garanderen.

De privacyrisico’s

Wat een belangrijk instrument zou kunnen zijn voor het achtervolgen van criminelen, pedofielen en terroristen, vormt tegelijkertijd een bedreiging voor de privacy van onschuldige burgers en een zeer nuttig wapen voor totalitaire regimes, stelt de cybersecurity-expert aan de kaak.

Het probleem met deze nieuwe tool zou eerder zijn waar ze naar die overeenkomsten gaan zoeken. De foto’s die op de apparaten zijn opgeslagen en in iCloud zijn opgeslagen, worden versleuteld opgeslagen op Apple-servers, maar zoals experts uitleggen, zijn de sleutels om deze codes te ontsleutelen eigendom van Apple.

De enige die end-to-end-codering (E2E) hebben, zijn die van iMessages die, net als WhatsApp, van het ene apparaat naar het andere zijn beveiligd, zodat alleen gebruikers ze kunnen zien. Dit is waar, in theorie, het nieuwe systeem van Apple zou komen.

Deze inhoudsanalyse is niet zo nieuw. Facebook scant berichten op naaktheid op zijn sociale netwerken (Facebook en Instagram). Apple heeft ook hash-systemen gebruikt om te zoeken naar afbeeldingen van kindermisbruik die via e-mail zijn verzonden, systemen die vergelijkbaar zijn met Gmail en andere cloud-e-mailproviders, die niet worden beschermd door end-to-end-codering.

Green gelooft dat deze technologie een verontrustende boodschap afgeeft. “Ongeacht de langetermijnplannen van Apple, ze hebben een heel duidelijk signaal afgegeven. (…) het is veilig om systemen te bouwen die de telefoons van gebruikers scannen op verboden inhoud”, legt hij uit op zijn Twitter-profiel.

Niet alle cybersecurity-experts zijn echter zo kritisch geweest. Nicholas Weaver, een senior research fellow bij het International Computer Science Institute van UC Berkeley, heeft verzekerd: Moederbord dat de nieuwe functie Berichten van Apple “een ZEER goed idee lijkt”. “Over het algemeen lijkt de aanpak van Apple goed doordacht om effectief te zijn en de privacy te maximaliseren”, voegt hij eraan toe.