Deepfakes worden voor een breed scala aan doeleinden gebruikt, ook in de context van desinformatiecampagnes, en het wordt steeds moeilijker om die bewerkte afbeeldingen te detecteren.

Hoe detecteert deze AI Deepfake-afbeeldingen?

Maar er is een nieuwe AI-tool om die nepvideo’s te herkennen, het controleert het licht dat in de ogen wordt weerspiegeld.

Het project is gemaakt door een team van computerwetenschappers van de Universiteit van Buffalo. Volgens de studie was deze nieuwe AI in staat om Deepfake-portretafbeeldingen te detecteren met een verrassend slagingspercentage van 94%.

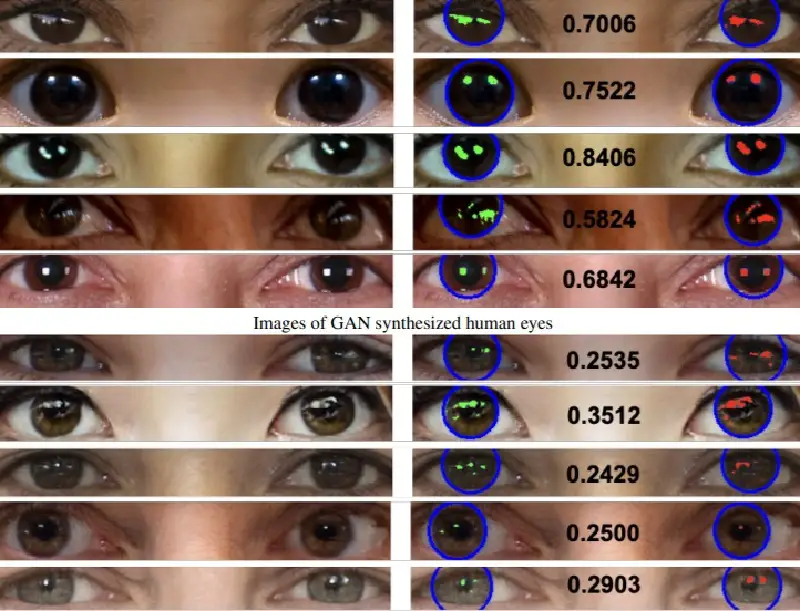

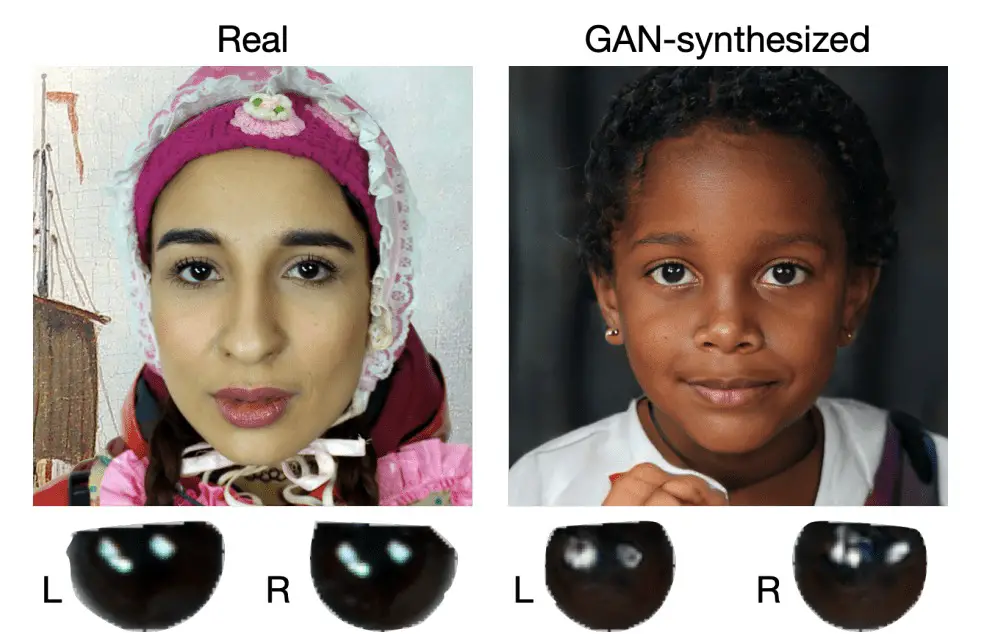

Het systeem legt de nepbeelden bloot door “de inconsistente hoornvliesspiegelingen tussen twee ogen” te analyseren.

Wanneer we een foto maken van een echt gezicht, zal de reflectie op de twee ogen vergelijkbaar zijn. Omdat ze hetzelfde zien. Maar over het algemeen slagen Deepfake-afbeeldingen er niet in om deze gelijkenis nauwkeurig vast te leggen, en zijn ze dus niet in staat om de ware gelijkenis vast te leggen van de persoon die ze proberen te imiteren.

Het systeem analyseert het beeld en berekent vervolgens een score die wordt gebruikt om de gelijkenis van de ene persoon met de andere te bepalen.

Het meest voor de hand liggende nadeel van het gereedschap is dat het een gereflecteerde lichtbron in beide ogen nodig heeft. Deze patronen kunnen eenvoudig worden gecorrigeerd met handmatige nabewerking en de methode werkt niet als er één oog op de afbeelding ontbreekt.

Microsoft koopt Nuance, het AI-bedrijf dat Siri gebruikt, voor 19,7 miljard dollar

Ook zal het systeem waarschijnlijk valse resultaten opleveren als de persoon op de foto niet naar de camera kijkt.