Kunstmatige intelligentie (AI) fascineert al lang sommige mensen en wordt door anderen bekritiseerd. Het is moeilijk geworden om te voorspellen wat mogelijk is en wat niet met AI. Een groep academici aan de University of British Columbia (UBC) in Vancouver heeft iets bedacht dat misschien sciencefiction lijkt: een volledig autonome AI-wetenschapper. Deze AI analyseert gegevens en creëert en voert experimenten uit. Deze ontdekking heeft zowel fascinerende als, voor sommigen, verontrustende implicaties.

Hoewel het idee van een AI-wetenschapper misschien een vergezochte droom lijkt, UBC-team heeft dit gerealiseerd door middel van partnerschappen met de Universiteit van Oxford en Sakana-AIHoewel deze door AI gegenereerde werkdocumenten in eerste instantie misschien niet veel bijdragen aan de wetenschap, vertegenwoordigt het feit dat ze het resultaat zijn van machinaal leren uit hun experimenten en dat ze werken een vooruitgang in AI-onderzoek.

De AI-wetenschapper die nooit stopt met leren

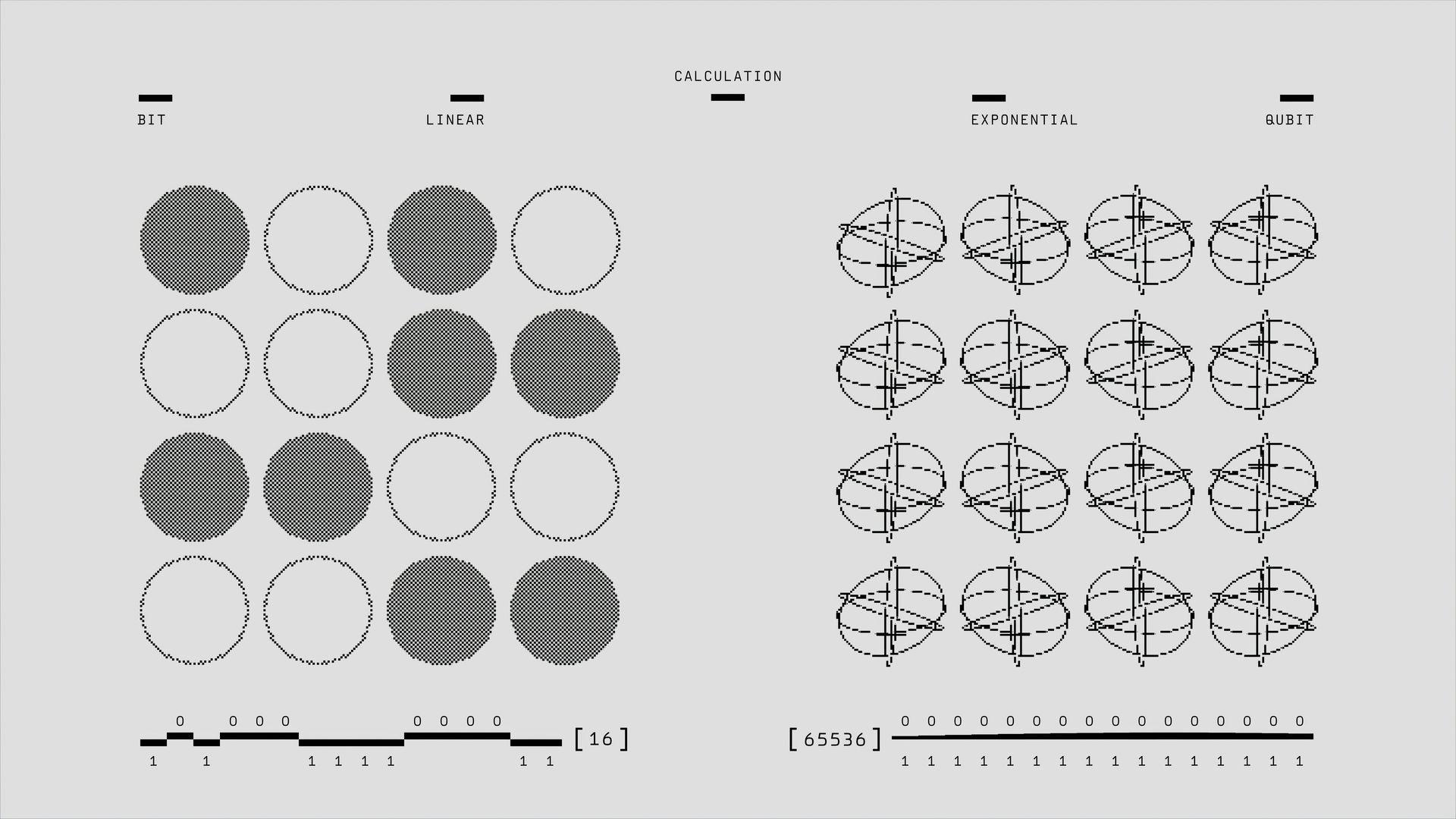

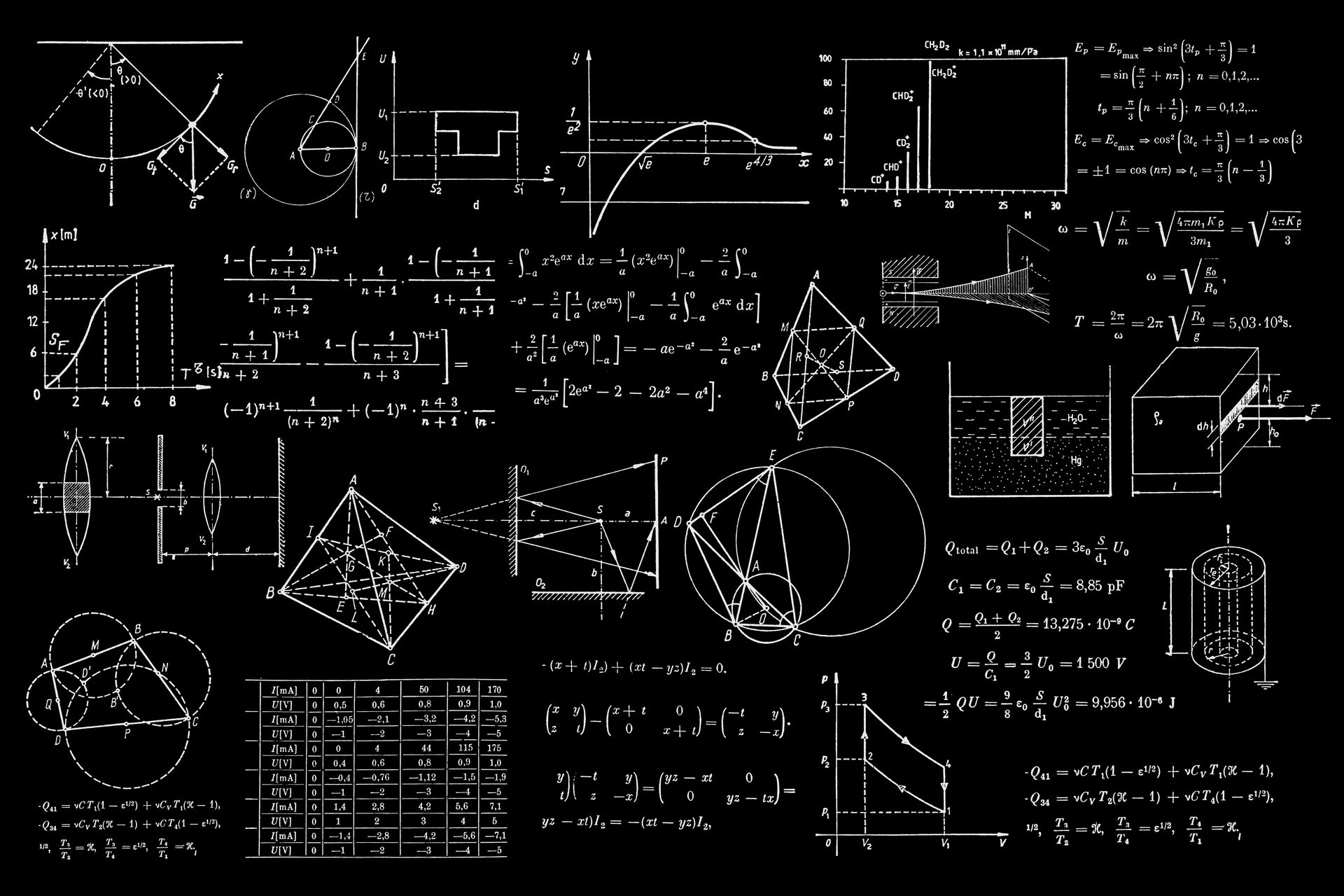

Dit werk is gecentreerd rond een aanpak die open-ended learning wordt genoemd. Deze nieuwe AI-wetenschapper functioneert anders dan traditionele AIdie afhankelijk is van enorme hoeveelheden data die door mensen zijn gecreëerd. Het leert door nieuwe dingen te proberen, ze te onderzoeken en te verfijnen. Met behulp van deze techniek kan AI de grenzen van de huidige kennis verleggen en misschien nieuwe inzichten vinden die menselijke onderzoekers mogelijk hebben gemist.

Een van de eerste taken die deze AI-wetenschapper aanpakte, was het verbeteren van bestaande technieken voor machinaal leren, zoals diffusiemodellering en het versnellen van diepe neurale netwerken. Hoewel dit misschien geen wereldschokkende ontwikkelingen lijken, vertegenwoordigen ze het vermogen van AI om ideeën autonoom te ontwikkelen en te testen. AI zelf kon niet veel dingen toen het voor het eerst uitkwam, maar nu is het begonnen elk aspect van ons leven binnen te dringen.

Jeff Clunede professor die het UBC-lab leidt, erkende dat de resultaten niet per se een succes zijn, maar ze zijn veelbelovend. De aanpak van de AI-wetenschapper om te leren – het voortdurend verfijnen van zijn experimenten en het zoeken naar dingen die hij “interessant” vindt – is een frisse afwijking van de meer rigide methoden die traditioneel worden gebruikt in AI-onderzoek.

AI-wetenschappers testen en verfijnen hun theorieën onafhankelijk van elkaar

Clune’s lab experimenteert al een tijdje met open-ended learning. In eerdere projecten hebben ze AI-programma’s ontwikkeld die zijn ontworpen om virtuele omgevingen te verkennen en gedragingen te genereren op basis van wat ze interessant vinden. Deze programma’s moesten zorgvuldig worden begeleid met handmatig gecodeerde instructies, maar de introductie van grote taalmodellen (LLM’s) heeft het spel veranderd. Nu kunnen deze AI-programma’s onafhankelijk bepalen wat de moeite waard is om te onderzoeken, waardoor ze autonomer en mogelijk creatiever zijn.

Het vermogen van de AI-wetenschapper om de code te schrijven die nodig is om hun theorieën te valideren, en om tests uit te voeren, is een van hun meest fascinerende eigenschappen. Dit stelt de AI in staat om zijn strategie voortdurend te verfijnen, steeds effectiever en misschien wel scherpzinniger te worden. Clune vergelijkt dit proces met het ontdekken van een nieuw continent, omdat beide de geest van verkenning en het onbekende en de mogelijkheid van grote verrassingen onderweg omvatten.

De betrouwbaarheid van zulke systemen is slecht, ondanks hun mooie toekomst. Hoewel AI-wetenschappers misschien opmerkelijk lijken, Tom Hoopeen onderzoeker bij de Allen Instituut voor AIzegt dat het nog steeds zeer afgeleid en onbetrouwbaar is. Dit wantrouwen komt voort uit het feit dat AI te veel belooft en ondermaats presteert, vooral op het gebied van creativiteit en echte innovatie.

Potentieel en risico beheren

Met de creatie van de AI-wetenschapper zijn er ook zorgen ontstaan over de richting van wetenschappelijk onderzoek. Wanneer AI zelf theorieën kan creëren en evalueren, waar zullen menselijke onderzoekers dan zijn? En hoe kunnen we ervoor zorgen dat deze AI-technologieën op de juiste manier worden gebruikt? Zou een kwaadwillende persoon thuis een AI-wetenschapper kunnen trainen en deze kunnen gebruiken voor kwade bedoelingen in de toekomst?

Deze AI-wetenschapper boekt al vooruitgang in het creëren van AI-agenten, autonome programma’s met vooraf bepaalde functies. De groep van Clune heeft door AI ontworpen agenten gecreëerd die beter presteren dan hun door de mens ontworpen tegenhangers in vaardigheden zoals wiskunde en leesbegrip. Dit succes suggereert een toekomst waarin AI kan bijdragen aan innovatie op manieren die nog onduidelijk zijn, in plaats van alleen te helpen bij dagelijkse activiteiten.

Maar er zijn gevaren verbonden aan deze vooruitgang. Het is behoorlijk verontrustend dat deze AI-systemen zich misdragende agenten kunnen produceren, of dat nu opzettelijk is of niet. Clune en zijn groep zijn zich bewust van de risico’s en proberen oplossingen te vinden om dit soort situaties te voorkomen. Ze beweren dat het geheim is om de creatie van deze systemen goed te overzien om hun sterkte en veiligheid te garanderen.

Hoewel het onduidelijk is waar dit toe zal leiden, is één ding zeker: AI-wetenschappers zijn er en ze zullen niet stoppen met slimmer worden. AI staat op het punt een nieuwe fase in te gaan en iedereen zal nauwlettend in de gaten houden of het tot baanbrekende bevindingen of nieuwe problemen leidt. Naarmate AI evolueert, zal het voor academici van vitaal belang zijn om ethische zorgen te benadrukken en ervoor te zorgen dat deze systemen ethisch worden gebouwd. Uiteindelijk zal de manier waarop we de complexe relatie tussen technologie en mensen aanpakken, bepalen hoe AI de maatschappij beïnvloedt.

Bron van de hoofdafbeelding: Nationaal Kankerinstituut / Unsplash

Source: AI-wetenschappers onderzoeken, leren en ontdekken